Serie IA 360° · Parte 5: Presupuesto

En El Padrino hay una escena que llevo años usando mentalmente como metáfora para explicar cómo las organizaciones se relacionan con la tecnología. Sonny Corleone quiere responder a un ataque con todo el arsenal disponible, sin calcular costos ni consecuencias. Michael, más frío y estratégico, le dice que está pensando emocionalmente, no racionalmente. Lo que parece la respuesta más poderosa no siempre es la correcta. Y lo que parece la más barata raramente lo es.

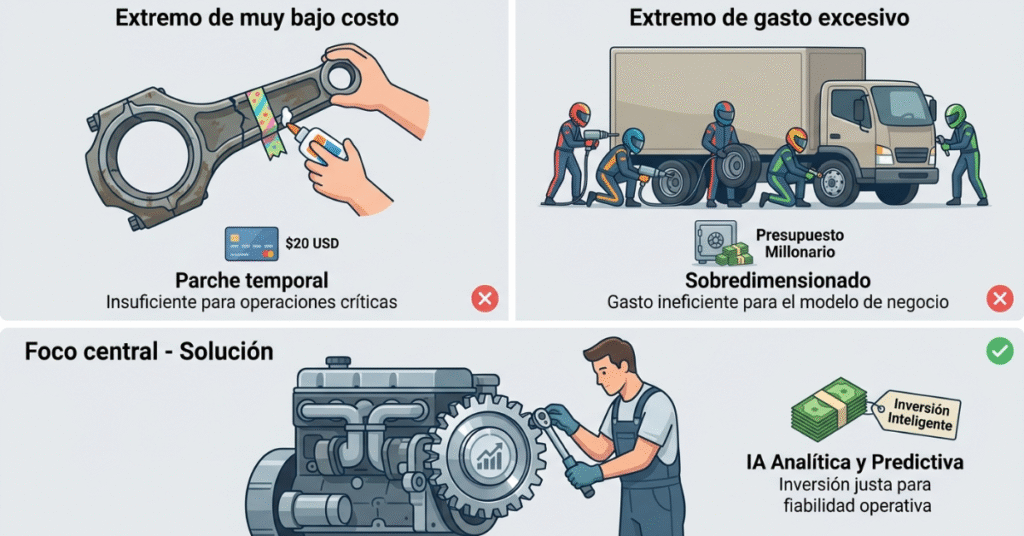

Con la IA empresarial estamos viviendo exactamente esas dos tentaciones al mismo tiempo, en extremos opuestos.

Durante años, la narrativa dominante fue la del presupuesto millonario: la IA era territorio exclusivo de grandes corporaciones con departamentos de datos de decenas de ingenieros y contratos de consultoría de siete cifras. Eso frenó a muchas organizaciones medianas que tenían problemas reales y perfectamente solucionables. Pero ahora el péndulo ha oscilado hacia el otro extremo, igual de peligroso: la ilusión de que una suscripción de veinte dólares al mes a ChatGPT resuelve los retos operacionales críticos de una empresa.

Ninguna de las dos narrativas es correcta. Y en la entrada anterior de esta serie ya exploramos el lado oculto de los costos variables que los proveedores no mencionan al momento de firmar. Hoy vamos un paso más atrás: al error de diagnóstico que precede a todo lo demás.

El primer error: confundir una herramienta de productividad personal con infraestructura empresarial

ChatGPT Plus por veinte dólares al mes es una herramienta extraordinaria para un profesional individual. Redacta mejor, piensa más rápido, ayuda a estructurar ideas, resume documentos, genera borradores. El problema no es la herramienta. El problema es lo que ocurre cuando una organización decide que eso es suficiente para atacar un reto operacional crítico.

La IA generativa —los modelos de lenguaje que están detrás de ChatGPT, Claude o Gemini— es excepcionalmente buena para tareas de generación, síntesis y razonamiento sobre texto. No es la herramienta adecuada para todos los problemas empresariales. Un proceso de validación de inventario en tiempo real, un sistema de detección de anomalías en transacciones financieras, o la automatización de un flujo de aprobaciones con múltiples condiciones de negocio: estos no son problemas de generación de texto. Son problemas de lógica determinista, integración de sistemas y control de flujo. Resolverlos con un chatbot generativo es como usar un destornillador de precisión para clavar un clavo. La herramienta no es mala. Simplemente no es la correcta.

«El error no es adoptar IA generativa. El error es creer que la IA generativa es la respuesta correcta para todos los retos empresariales.»

El segundo error: la ilusión de los agentes que procesan todo

Hay un segundo espejismo que ha ganado tracción enorme en los últimos meses: la promesa de los agentes autónomos. La idea es seductora. Configuras un agente, le das acceso a tus sistemas, y él se encarga de procesar, decidir y ejecutar sin intervención humana. El sueño de la automatización total, aparentemente al alcance de cualquier presupuesto.

El problema, como ya exploramos en nuestra entrada sobre el costo real de la IA, es que ese modelo tiene una trampa económica que muy pocos ven antes de caer en ella. Lo que hoy parece marginal —unas cuantas llamadas a la API, unos miles de tokens por interacción— escala de forma no lineal en cuanto el agente empieza a operar en volumen real. Y los cambios recientes en las políticas de uso de las grandes plataformas —OpenAI, Anthropic con Claude, Google con Gemini— están convirtiendo lo que parecía un costo fijo y predecible en un modelo completamente variable donde el gasto puede multiplicarse sin que nadie en la organización lo haya notado.

Un agente mal diseñado que corre en loops, que procesa más contexto del necesario, que no tiene mecanismos de control de frecuencia, puede generar una factura de infraestructura que ningún directivo habría aprobado en una propuesta formal. Y lo más delicado es que ese gasto aparece después, cuando el proyecto ya está en producción y desactivarlo tiene un costo operativo propio.

Pero el costo económico no es el único problema que se subestima. Hay dos dimensiones adicionales que en entornos empresariales deberían pesar igual o más en la decisión.

La primera es la privacidad. Cuando un agente autónomo procesa información operacional crítica —contratos, datos de clientes, registros financieros, comunicaciones internas— esa información está viajando hacia los servidores de un tercero bajo condiciones de uso que muy pocas organizaciones han leído con detenimiento. Las políticas de retención de datos, el uso de esas interacciones para entrenar modelos futuros, la jurisdicción legal aplicable: son preguntas que deberían responderse antes de conectar un agente a los sistemas core del negocio, no después de que un auditor las haga.

La segunda es la trazabilidad. Los modelos de lenguaje grandes son, por naturaleza, cajas con opacidad considerable. Cuando un agente toma una decisión —clasifica un documento, prioriza una solicitud, rechaza una transacción— la capacidad de explicar con precisión por qué tomó esa decisión es limitada. En procesos donde la trazabilidad es un requisito regulatorio, operacional o simplemente de sentido común empresarial, esa opacidad no es un detalle técnico menor. Es un riesgo de gobierno que puede tener consecuencias reales.

«Dar acceso a un agente autónomo a tus sistemas sin entender qué hace con los datos y por qué toma cada decisión no es automatización. Es delegar el control sin saber a quién.»

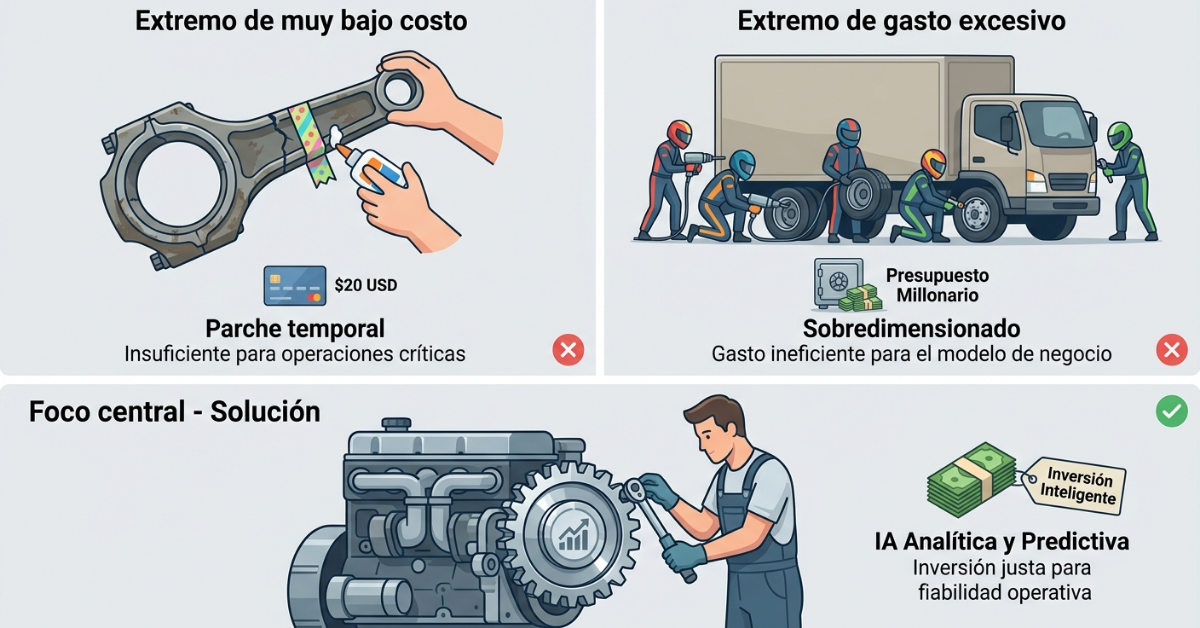

El territorio real: entre el millón y los veinte dólares

La buena noticia —y sí la hay— es que existe un territorio amplio y perfectamente habitable entre ambos extremos. Empresas medianas que implementan soluciones de IA bien diseñadas, acotadas a problemas específicos y con la arquitectura correcta para el tipo de problema que están resolviendo, recuperan su inversión en menos de ocho meses y reportan incrementos de productividad que en muchos casos superan el 23%.

Pero esos resultados no vienen de suscribirse a una plataforma y esperar que la magia ocurra. Vienen de hacer tres preguntas antes de elegir cualquier herramienta: ¿Qué tipo de problema estoy resolviendo realmente? ¿Es este un problema donde la IA generativa agrega valor, o necesito otro tipo de inteligencia artificial? ¿Y cuál es el costo real de esta solución cuando opera en el volumen que mi negocio requiere, no en una demo de laboratorio?

«El presupuesto correcto no es el más alto ni el más bajo. Es el que corresponde al problema real, con la herramienta correcta, diseñada para escalar sin sorpresas.»

Michael tenía razón en aquella escena. No se trata de responder con todo el arsenal disponible ni de ignorar el problema porque parece costoso. Se trata de pensar con claridad, elegir la herramienta que corresponde al problema, y entender completamente las consecuencias antes de actuar.

En la próxima entrada de la serie IA 360° abordaremos uno de los temas que más malentendidos genera en los equipos directivos: la gobernanza. Y lo primero que aclararemos es que gobernanza no significa burocracia paralizante ni comités interminables de aprobación. Significa exactamente lo contrario: rieles claros que permiten a las organizaciones experimentar rápido, fallar de forma controlada y escalar lo que funciona, todo dentro de límites definidos que protegen el negocio sin frenar la innovación.

Sobre el autor: Carlos Carrasco es CTO de Evolvis AI. Es Doctor en Sistemas Inteligentes por el Tecnológico de Monterrey, candidato a MBA y ex investigador senior del Barcelona Supercomputing Center. Cuenta con más de 20 publicaciones científicas y ha liderado proyectos de gran escala, impulsando el desarrollo y la aplicación de inteligencia artificial en diversas industrias.

Contáctenos: info@evolvis.ai